Робототехника

139,602

350

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

30 июня 2022

В гимназии города Лабытнанги, ЯНАО, начнут изучать сервисную робототехнику вместе с российским роботом Promobot. Робот будет преподавать школьникам сразу несколько дисциплин и выступать «живым» лабораторным стендом. Робот уже прибыл по месту назначения и уже применяется в образовательных процессах летнего школьного лагеря. В активную фазу работы робот перейдет первого сентября. Об этом CNews сообщили представители компании «Промобот».

Робот Promobot V.4 — это сервисный робот для работы в местах массового скопления людей. Робот может трудиться консультантом, администратором, гидом или сотрудником аэропорта. На базе промобота школьники изучат как программирование, так и электронику и мехатронику — в программу входит шесть лабораторных работ.

«Особенность изучения робототехники с промоботом в том, что это “реальный” робот, работающий сегодня уже в 43 странах мира. Дети узнают о работе искусственного интеллекта на живом примере, а не виртуальных моделях. Это уникальная возможность: российский робот, точные копии которого работают по всему миру — от США до Австралии. Дети будут разрабатывать целые проекты — и любое удачное решение может попасть из школьной лаборатории прямо к нашим разработчикам, а затем — появиться на роботе, скажем, в национальном Банке Омана», — сказал директор по развитию

https://www.cnews.ru…j_gimnazii

В гимназии города Лабытнанги, ЯНАО, начнут изучать сервисную робототехнику вместе с российским роботом Promobot. Робот будет преподавать школьникам сразу несколько дисциплин и выступать «живым» лабораторным стендом. Робот уже прибыл по месту назначения и уже применяется в образовательных процессах летнего школьного лагеря. В активную фазу работы робот перейдет первого сентября. Об этом CNews сообщили представители компании «Промобот».

Робот Promobot V.4 — это сервисный робот для работы в местах массового скопления людей. Робот может трудиться консультантом, администратором, гидом или сотрудником аэропорта. На базе промобота школьники изучат как программирование, так и электронику и мехатронику — в программу входит шесть лабораторных работ.

«Особенность изучения робототехники с промоботом в том, что это “реальный” робот, работающий сегодня уже в 43 странах мира. Дети узнают о работе искусственного интеллекта на живом примере, а не виртуальных моделях. Это уникальная возможность: российский робот, точные копии которого работают по всему миру — от США до Австралии. Дети будут разрабатывать целые проекты — и любое удачное решение может попасть из школьной лаборатории прямо к нашим разработчикам, а затем — появиться на роботе, скажем, в национальном Банке Омана», — сказал директор по развитию

https://www.cnews.ru…j_gimnazii

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Южный Урал

Карма: +51.66

Регистрация: 14.02.2017

Сообщений: 1,042

Читатели: 3

Регистрация: 14.02.2017

Сообщений: 1,042

Читатели: 3

Внутри ящика со звукоизоляцией — одна из худших во всём мире нейронных сетей. Когда ей представляют изображение числа 6, она останавливается на мгновение и определяет цифру — 0. Руководитель разработки этой сети — физик-инженер из Корнельского университета Питер МакМахон с робкой улыбкой защищает её. Он указывает, что написанное от руки число выглядит неаккуратно. А Логан Райт — постдокторант, посетивший лабораторию МакМахона из NTT Research, уверяет, что обычно устройство отвечает верно, но признаёт, что ошибки случаются часто.

Эта нейронная сеть — новаторская, несмотря на неутешительную производительность. Другие нейросети работают в цифровом мире нулей и единиц, но это устройство работает на звуке. Исследователи переворачивают ящик — и обнаруживают не компьютерный чип, а микрофон с наклоном к титановой пластине, которая прикручена к динамику. Когда Райт воспроизводит новое изображение цифры, пиксели преобразуются в звук, и, когда динамик трясёт пластину, лаборатория наполняется слабым дребезжанием. Чтение выполняет не программное обеспечение на кремниевом чипе, а металлические реверберации. Даже разработчикам устройства не верится, что оно часто работает с успехом.

«Каким бы ни было назначение вибрирующего металла, оно не должно иметь ничего общего с классификацией рукописной цифры», — отмечает МакМахон.

Примитивная способность устройства к чтению, которую эта группа учёных представила в январской статье Nature, даёт учёным надежду, что далёким потомкам по силам будет совершить революцию в вычислительной технике.

Cпециалисты в компьютерной науке находят, что больше — значит лучше, когда речь идёт о традиционном ML. Наполнение сети большим количеством хранящих числа искусственных узлов улучшает её способность отличить таксу от далматина или преуспевать во множестве других задач распознавания образов. Потрясающие нейронные сети справляются с различными задачами — сочиняют эссе и создают иллюстрации. С большей вычислительной мощью возможными могут стать ещё более грандиозные подвиги. Этот потенциал мотивировал большие усилия по разработке мощных и эффективных методов вычислений.

МакМахон и группа его единомышленников отстаивают неортодоксальный подход. Они хотят заставить Вселенную считать за нас. «Многие физические системы естественным образом выполняют некоторые вычисления эффективнее или быстрее компьютерных вычислений», — сказал МакМахон. Когда инженеры проектируют самолёт, они могут оцифровывать чертежи и часами работать на суперкомпьютере, моделировать обтекание крыльев воздухом. Или поместить машину в аэродинамическую трубу и посмотреть, полетит ли она. Аэродинамическая труба мгновенно «рассчитывает» взаимодействие крыльев с воздухом.

Такие исследователи, как МакМахон, ищут устройство, способное научиться делать что угодно, — систему, которая может адаптировать поведение путём проб и ошибок, чтобы приобрести любую новую способность, например, классифицировать рукописные цифры или отличать одну произносимую гласную от другой. Недавняя работа показала, что физические системы, такие как волны света, сети сверхпроводников и ветвящиеся потоки электронов, способны к обучению.

«Заново изобретается не только аппаратное обеспечение, но и вся вычислительная парадигма», — рассказывает математик из Швейцарского федерального технологического института в Цюрихе Бенджамин Селье который помог в разработке нового алгоритма обучения на основе физики.

Даже это новшество не сможет превзойти современный кремниевый чип. Но создающие эти системы физики подозревают, что цифровые нейронные сети — какими бы мощными они ни казались сегодня — будут медленными и неадекватными по сравнению со своими аналоговыми родственниками. Цифровые нейронные сети могут масштабироваться лишь до тех пор, пока не увязнут в чрезмерных вычислениях, но физическим сетям крупнее не нужно делать ничего, кроме как быть самими собой.

«Это такая большая, динамично развивающаяся и разнообразная область; мне трудно поверить, что на этих принципах не появятся достаточно мощные компьютеры», — делится мнением Диллаву.

Честно попёрто с Хабра

Эта нейронная сеть — новаторская, несмотря на неутешительную производительность. Другие нейросети работают в цифровом мире нулей и единиц, но это устройство работает на звуке. Исследователи переворачивают ящик — и обнаруживают не компьютерный чип, а микрофон с наклоном к титановой пластине, которая прикручена к динамику. Когда Райт воспроизводит новое изображение цифры, пиксели преобразуются в звук, и, когда динамик трясёт пластину, лаборатория наполняется слабым дребезжанием. Чтение выполняет не программное обеспечение на кремниевом чипе, а металлические реверберации. Даже разработчикам устройства не верится, что оно часто работает с успехом.

«Каким бы ни было назначение вибрирующего металла, оно не должно иметь ничего общего с классификацией рукописной цифры», — отмечает МакМахон.

Примитивная способность устройства к чтению, которую эта группа учёных представила в январской статье Nature, даёт учёным надежду, что далёким потомкам по силам будет совершить революцию в вычислительной технике.

Cпециалисты в компьютерной науке находят, что больше — значит лучше, когда речь идёт о традиционном ML. Наполнение сети большим количеством хранящих числа искусственных узлов улучшает её способность отличить таксу от далматина или преуспевать во множестве других задач распознавания образов. Потрясающие нейронные сети справляются с различными задачами — сочиняют эссе и создают иллюстрации. С большей вычислительной мощью возможными могут стать ещё более грандиозные подвиги. Этот потенциал мотивировал большие усилия по разработке мощных и эффективных методов вычислений.

МакМахон и группа его единомышленников отстаивают неортодоксальный подход. Они хотят заставить Вселенную считать за нас. «Многие физические системы естественным образом выполняют некоторые вычисления эффективнее или быстрее компьютерных вычислений», — сказал МакМахон. Когда инженеры проектируют самолёт, они могут оцифровывать чертежи и часами работать на суперкомпьютере, моделировать обтекание крыльев воздухом. Или поместить машину в аэродинамическую трубу и посмотреть, полетит ли она. Аэродинамическая труба мгновенно «рассчитывает» взаимодействие крыльев с воздухом.

Такие исследователи, как МакМахон, ищут устройство, способное научиться делать что угодно, — систему, которая может адаптировать поведение путём проб и ошибок, чтобы приобрести любую новую способность, например, классифицировать рукописные цифры или отличать одну произносимую гласную от другой. Недавняя работа показала, что физические системы, такие как волны света, сети сверхпроводников и ветвящиеся потоки электронов, способны к обучению.

«Заново изобретается не только аппаратное обеспечение, но и вся вычислительная парадигма», — рассказывает математик из Швейцарского федерального технологического института в Цюрихе Бенджамин Селье который помог в разработке нового алгоритма обучения на основе физики.

Учимся размышлять

Даже это новшество не сможет превзойти современный кремниевый чип. Но создающие эти системы физики подозревают, что цифровые нейронные сети — какими бы мощными они ни казались сегодня — будут медленными и неадекватными по сравнению со своими аналоговыми родственниками. Цифровые нейронные сети могут масштабироваться лишь до тех пор, пока не увязнут в чрезмерных вычислениях, но физическим сетям крупнее не нужно делать ничего, кроме как быть самими собой.

«Это такая большая, динамично развивающаяся и разнообразная область; мне трудно поверить, что на этих принципах не появятся достаточно мощные компьютеры», — делится мнением Диллаву.

Честно попёрто с Хабра

Будет али нет, а ты паши да сей. В лучшее верить надо!

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

05 АВГУСТ 2022

Исследователи из Университета Санта-Клары, Технологического института Нью-Джерси и Университета Гонконга научили микророботов плавать и свободно ориентироваться в пространстве. Для этого учёные использовали искусственный интеллект и глубокое обучение с подкреплением. Исследование опубликовано в журнале Communications Physics.

Исследователи считают, что сейчас интерес к плавающим микророботам только растёт. Подобные устройства востребованы в медицине и микрохирургии, но пока большинство таких роботов способно выполнять только самые простые манёвры.

В результате исследования учёные пришли к выводу, что микророботы могут адаптироваться к постоянно меняющимся условиям водной среды с помощью ИИ.

Объединив искусственные нейронные сети с обучением с подкреплением, команда успешно научила микроробота плавать и перемещаться в любом направлении. Когда устройство движется определённым образом, оно получает обратную связь, то есть оценку любого своего действия. Таким образом робот постепенно учится плавать, основываясь на своём опыте взаимодействия с окружающей средой.

"Подобно тому, как человек учится плавать, робот учится перемещать свои "части тела" — в данном случае три микрочастицы и растяжимые соединения — для самостоятельного движения и поворота. Он делает это, не полагаясь на человеческие знания, а только на алгоритм машинного обучения", — объяснил Алан Цанг (Alan Tsang), доцент кафедры машиностроения в Университет Гонконга.

Учёные уже успешно протестировали разработку, подтвердив способность робота свободно перемещаться в потоках жидкости.

https://mashnews.ru/…yu-ii.html

Исследователи из Университета Санта-Клары, Технологического института Нью-Джерси и Университета Гонконга научили микророботов плавать и свободно ориентироваться в пространстве. Для этого учёные использовали искусственный интеллект и глубокое обучение с подкреплением. Исследование опубликовано в журнале Communications Physics.

Исследователи считают, что сейчас интерес к плавающим микророботам только растёт. Подобные устройства востребованы в медицине и микрохирургии, но пока большинство таких роботов способно выполнять только самые простые манёвры.

В результате исследования учёные пришли к выводу, что микророботы могут адаптироваться к постоянно меняющимся условиям водной среды с помощью ИИ.

Объединив искусственные нейронные сети с обучением с подкреплением, команда успешно научила микроробота плавать и перемещаться в любом направлении. Когда устройство движется определённым образом, оно получает обратную связь, то есть оценку любого своего действия. Таким образом робот постепенно учится плавать, основываясь на своём опыте взаимодействия с окружающей средой.

"Подобно тому, как человек учится плавать, робот учится перемещать свои "части тела" — в данном случае три микрочастицы и растяжимые соединения — для самостоятельного движения и поворота. Он делает это, не полагаясь на человеческие знания, а только на алгоритм машинного обучения", — объяснил Алан Цанг (Alan Tsang), доцент кафедры машиностроения в Университет Гонконга.

Учёные уже успешно протестировали разработку, подтвердив способность робота свободно перемещаться в потоках жидкости.

https://mashnews.ru/…yu-ii.html

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

16.08.2022

Центральное конструкторское бюро "Рубин" (ЦКБ "Рубин" показало демонстрационный образец автономного необитаемого подводного аппарата (АНПА) "Юнона", предназначенного для поисковых и осмотровых работ, передает ТАСС.

"Комплекс АНПА "Юнона" предназначен для выполнения подводных поисковых и осмотровых работ, решения поисковых задач при обеспечении спасательных операций, картографирования, исследования топографии, определения рельефа дна, в том числе в условиях мелководья, исследования акваторий в части измерения температуры, скорости звука и определения расположения температурных границ", - говорится в информационном буклете, представленном на стенде "Рубина".

АНПА "Юнона" имеет открытую архитектуру, поэтому может оснащаться сменными модулями дополнительной полезной нагрузки. Беспилотник можно запускать как с маломерных судов и катеров, так и с морских сооружений, пирсов или необорудованного побережья.

В стандартную комплектацию системы "Юнона" входят гидролокатор бокового обзора, цифровая фотовидеокамера, приемник спутниковых сигналов GPS/ГЛОНАСС, датчики измерения скорости звука, давления и температуры, гидроакустическая система позиционирования и связи и т.д. Комплект берегового оборудования включает программно-аппаратные средства, транспортный контейнер, антенны радио- и гидроакустической связи и Wi-Fi.

Предельная глубина погружения АНПА - 1 км, максимальная скорость подводного хода - 3 м/с, максимальная дальность хода - 30 км. Автономность работы аппарата "Юнона" достигает шести часов, масса - 87 кг, длина - 2,9 метра, диаметр - 200 мм.

https://www.korabel.…-2022.html

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

8 сентября 2022

Одним из НПО, расположенным в российской столице, разработана достаточно интересная промышленная роботизированная установка, которая может заниматься сортировкой товаров, перемещением или перекладкой продукции, а также другими работами, функционируя совместно с человеком.

В настоящее время роботы, установленные на промышленных объектах, как правило, автономны и никак не контролируют возможное присутствие рядом с ними человека, в связи с чем такая техника ограждается в целях безопасности персонала.

Однако новый робот, называемый коллаборативным, вполне может функционировать вместе с людьми — то есть работать совместно в общей рабочей зоне или помещении без необходимости приостановки производства. Это обеспечивается «системой технического зрения», которую получил робот.

Также отмечается, что данный робот имеет специальную конструкцию, благодаря которой стало возможно комбинировать установленные модули захвата в целях выполнения им специфических задач узкой направленности.

Это может серьезно сократить расходы производителя на приобретение вспомогательного оборудования, а также время, затраченное на его настройку и программирование всей производственной линии, что, в свою очередь, снизит сроки постановки на конвейер новой продукции.

Помимо этого сообщается, что цена такого робота почти на 20 % ниже аналогичных зарубежных аналогов, а основная часть комплектующих производится на российских предприятиях, что весьма значительно упростит процесс технического обслуживания роботов.

https://www.techcult…nnyj-robot

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

30.12.2022

С появлением коллаборативных роботов стало возможным автоматизировать множество технологических процессов. Но это не тот сценарий, когда роботы полностью заменят людей. Коллаборативные роботы (коботы) позволяют избавить сотрудников от физически сложных, опасных или просто рутинных операций.

В новой статье 3DVision рассмотрели ведущие модели коботов Doosan и примеры их применения для решения производственных и образовательных задач.

https://www.oborudun…ases/34942

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

28 января 2023

Российская компания «Автономика» представила робота, который получил название «Пиксель». Робот предназначен для уборки городских улиц.

Разработчики утверждают, что «Пиксель» практически на 100% состоит из российских комплектующих. Используемое программное обеспечение также было разработано в России.

Для самостоятельного перемещения робота используется система компьютерного зрения с функцией самообучения. Робот оснащен электрической силовой установкой, характеристики которой не указываются. Предусмотрена возможность смены навесного оборудования.

Полностью автономный беспилотный робот-уборщик создан для бесшумной и качественной уборки садово-парковых и других территорий. Сменное навесное оборудование обеспечит поддержание чистой и комфортной городской среды вне зависимости от погоды, времени суток, сезона или свободных “рабочих рук”.- «Автономика»

К преимуществам робота относят полный привод, работу без подзарядки до 16 часов, большой вместительный бак для воды и мусора, функции Follow me и автоматической парковки.

Ожидается, что скоро на улицах Москвы появится около 15 таких роботов-уборщиков.

https://www.ixbt.com…-i-po.html

https://iz.ru/146061…borshchiki

Отредактировано: Slav Rus - 29 янв 2023 17:11:31

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Южный Урал

Карма: +51.66

Регистрация: 14.02.2017

Сообщений: 1,042

Читатели: 3

Регистрация: 14.02.2017

Сообщений: 1,042

Читатели: 3

Следующее видео о том, как проходила тренировка роботика

Отредактировано: Zkvxz - 01 фев 2023 06:47:55

Будет али нет, а ты паши да сей. В лучшее верить надо!

Карма: +1.66

Регистрация: 27.03.2009

Сообщений: 2,141

Читатели: 0

Регистрация: 27.03.2009

Сообщений: 2,141

Читатели: 0

Цитата: Zkvxz от 01.02.2023 06:46:48Следующее видео о том, как проходила тренировка роботика

Ага, по "матам" из "фольги 20 мм" он бегает. И по досочке в 40 мм. Леса прочнее чем кирпичная стена тоже доставляют

Пусть хоть раз в этих роликах спрыгнет на мягкий спортивный мат. Ну или по песочку пляжному пробежит.

Москва

20 лет

Карма: +279.10

Регистрация: 22.07.2010

Сообщений: 5,503

Читатели: 7

Регистрация: 22.07.2010

Сообщений: 5,503

Читатели: 7

Цитата: psv от 01.02.2023 09:41:52Ага, по "матам" из "фольги 20 мм" он бегает. И по досочке в 40 мм. Леса прочнее чем кирпичная стена тоже доставляют

Пусть хоть раз в этих роликах спрыгнет на мягкий спортивный мат. Ну или по песочку пляжному пробежит.

У Вас претензии к компьютерной графике есть? Нет.

Причём здесь маты и леса.

Карма: +1.66

Регистрация: 27.03.2009

Сообщений: 2,141

Читатели: 0

Регистрация: 27.03.2009

Сообщений: 2,141

Читатели: 0

Цитата: ДядяВася от 01.02.2023 13:16:19У Вас претензии к компьютерной графике есть? Нет.

Причём здесь маты и леса.

Это не графика, прогибы настилов хотя и весьма малые есть. Но вот эта "искусственность стабильности обстановки" может производить впечатление симуляции.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

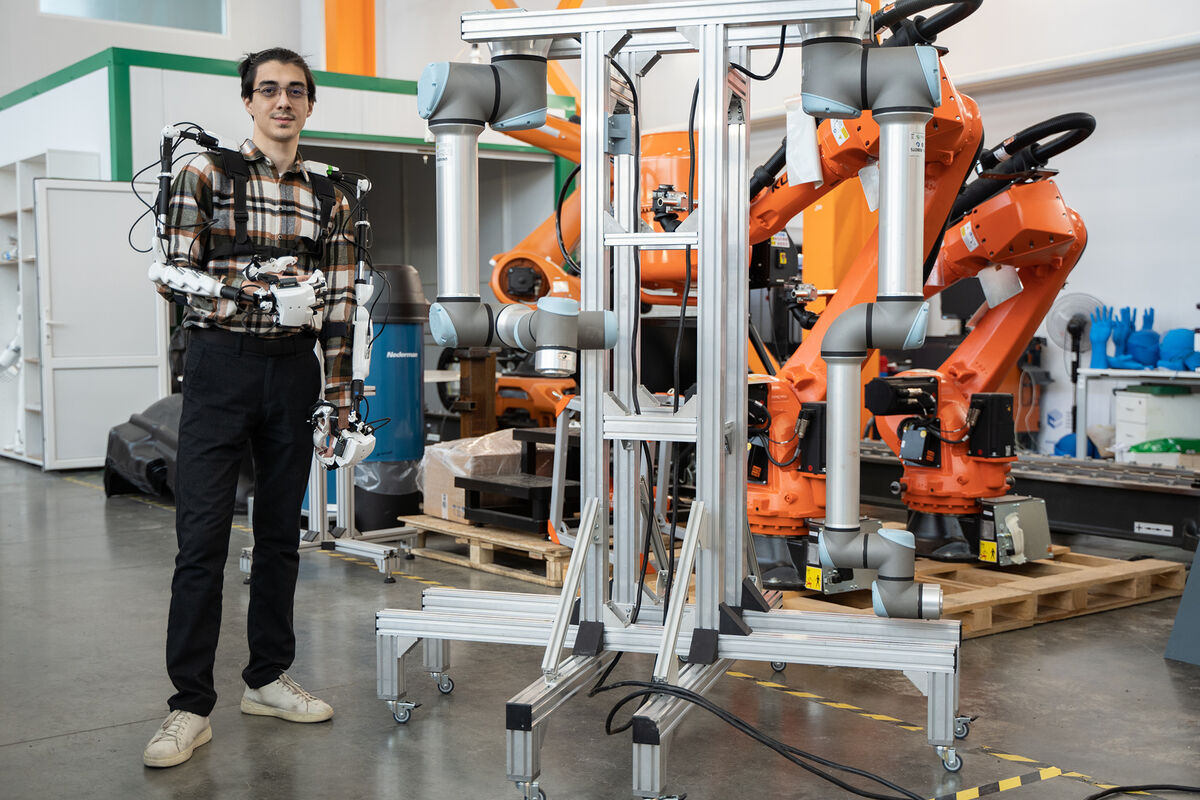

В Центре компетенций НТИ Иннополис запустили испытания системы дистанционного управления промышленными роботами

Новость 218 0

Новость 218 0

27 января 2023

Центр компетенций НТИ на базе Университета Иннополис запустил лабораторные испытания системы «Аватар», предназначенной для дистанционного управления промышленными роботами. Об этом сообщает издание «Газета.Ru» со ссылкой на пресс‑службу вуза.

Система представляет собой модификацию экзоскелета от компании «Андроидная техника», подключаемого при помощи внешнего компьютера к «роборуке». «Роборука» представляет собой промышленный или коллаборативный манипулятор.

Скрытый текст

https://habr.com/ru/news/t/713260/

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

10.02.2023

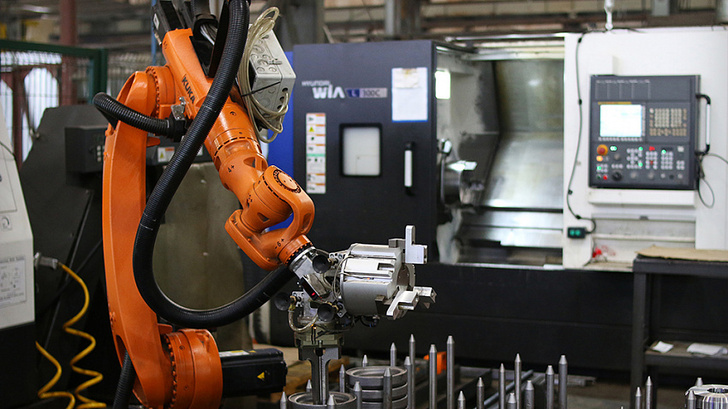

В Челябинске забили первые сваи в основание завода промышленных роботов-манипуляторов. Новое предприятие разместится на улице Горелова в Ленинском районе.

На проектную мощность 600 роботов в год завод должен выйти в первом квартале 2024 года.

Челябинская техника должна заменить ушедших с рынка японские Fanuc и Kuka. Оборудование компании «Русский робот» стоит на вооружении Челябинского кузнечно-прессового завода. Корпус машины выполнен из алюминия.

Компьютерная программа шестиосевого робота написана в России. Также планируется внедрить в конструкцию отечественные редуктор и компенсатор.

Производство роботов обеспечит спрос на кадры с высшим образованием. При том, что потребуются интеграторы роботизированных систем, необходимо порядка 300 специалистов разных профессий.

На территории ЧКПЗ опытное производство роботов-манипуляторов появилось в 2020 году. Образцы устройств дважды представляли на международной промышленной выставке «Иннопром» в Екатеринбурге. В 2021 году гостям мероприятия продемонстрировали «Миасс», а в 2022-м — «Златоуст».

https://bfm74.r...odstvu-robotov/

https://ura.news/news/1052623135

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Контроль состояния атмосферы в зоне действия промышленных предприятий - актуальная проблема для многих населенных пунктов и городов. Традиционно устанавливаются стационарные станции мониторинга качества воздуха. Однако, для полноценной оценки загрязнения воздуха необходимо иметь несколько станций мониторинга, причем, месторасположение зависит от сезонной смены преобладающих ветров, изменений ландшафта, появления новых объектов застройки.

Станция контроля качества воздуха, установленная на мобильном роботе T5 Атмосфера, позволяет решить задачу экологического мониторинга наилучшим образом. Мобильный робот способен менять свое местоположение в автоматическом режиме, он самостоятельно переместится из одной позиции в другую, сделав это в заданное время, совершит объезд территории промышленного предприятия, произведет замеры во множестве позиций. Данные измерений робот передает диспетчеру. Кроме того, они могут быть доступны на web-странице робота для всех авторизованных пользователей.

Мобильный робот способен заменить несколько стационарных станций мониторинга атмосферы, а позиции для проведения измерений могут быть легко перепрограммированы удаленно, без каких-либо дополнительных затрат.

Аккумуляторы робота способны обеспечить работу станции контроля качества воздуха в течении суток. При разряде аккумуляторов робот проследует к зарядной станции и подключится к ней в автоматическом режиме без какого-либо участия человека. Зарядка робота может осуществляться как от электрической сети, так и автономно, от поворотной солнечной батареи.

Робот экологического контроля состояния атмосферы способен работать как днем, так и ночью. Робот T5 Атмосфера способен двигаться в полной темноте, поскольку оснащен собственной инфракрасной подсветкой пути движения.

....

https://www.smprobot…логический

https://www.smprobotics.ru/

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

15 марта 2023

«Почта России» запустила в Санкт-Петербурге роботизированный пункт приёма и выдачи отправлений – складомат. Это первое в России подобное устройство, где всю работу выполняет машина. Аппарат выдает посылку в течение 1 минуты.

Складомат автоматизирован, участие сотрудников требуется только для предварительной загрузки посылок через шлюз. После этого устройство само распределяет отправления по полкам в зависимости от габаритов посылок. Благодаря интеллектуальным алгоритмам и машинному зрению аппарат точно знает, где находится каждая посылка, и не совершает ошибок.

https://www.cnews.ru…_zapustila

«Почта России» запустила в Санкт-Петербурге роботизированный пункт приёма и выдачи отправлений – складомат. Это первое в России подобное устройство, где всю работу выполняет машина. Аппарат выдает посылку в течение 1 минуты.

Складомат автоматизирован, участие сотрудников требуется только для предварительной загрузки посылок через шлюз. После этого устройство само распределяет отправления по полкам в зависимости от габаритов посылок. Благодаря интеллектуальным алгоритмам и машинному зрению аппарат точно знает, где находится каждая посылка, и не совершает ошибок.

Скрытый текст

https://www.cnews.ru…_zapustila

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Карма: +15.38

Регистрация: 20.07.2022

Сообщений: 254

Читатели: 1

Регистрация: 20.07.2022

Сообщений: 254

Читатели: 1

Многофункциональный робот может применяться и под водой, и на суше. Разработка успешно прошла испытания в соленой воде и при высоких дозах радиации.

Робот опускается на глубину до 4 метров, поднимает и переносит до 25 кг груза под водой. На суше он может разобрать завалы после землетрясения, выполнить разведывательные, аварийно-спасательные и взрывотехнические работы. В состав комплекса входит мобильный робот - четырехгусеничное шасси с манипулятором, различным оборудованием и постом дистанционного управления.

Производство локализовано на территории ОЭЗ "Технополис Москва".

Всего в ассортименте предприятия "Специальное конструкторско-технологическое бюро прикладной робототехники" более 20 моделей роботов разного класса и назначения для атомной промышленности, органов безопасности и МЧС. Оборудование внедрено на ряд атомных электростанций, в частности оно осуществляет ремонт бассейнов выдержки отработанного ядерного топлива АЭС нового типа.

Робот опускается на глубину до 4 метров, поднимает и переносит до 25 кг груза под водой. На суше он может разобрать завалы после землетрясения, выполнить разведывательные, аварийно-спасательные и взрывотехнические работы. В состав комплекса входит мобильный робот - четырехгусеничное шасси с манипулятором, различным оборудованием и постом дистанционного управления.

Производство локализовано на территории ОЭЗ "Технополис Москва".

Всего в ассортименте предприятия "Специальное конструкторско-технологическое бюро прикладной робототехники" более 20 моделей роботов разного класса и назначения для атомной промышленности, органов безопасности и МЧС. Оборудование внедрено на ряд атомных электростанций, в частности оно осуществляет ремонт бассейнов выдержки отработанного ядерного топлива АЭС нового типа.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

13 апреля 2023 г.

По сообщению медиацентра «Сколково», «РЖД-технологии» совместно с компанией «Робин» создали платформу программных роботов для транспортно-логистических предприятий.

Эффект: выполнение рутинных операций сократилось на 33,5 %. Общий бюджет проекта 100 млн рублей, из них размер гранта «Сколково» по нацпроекту «Цифровая экономика РФ» 75 млн руб.

Платформа дает возможность транспортно-логистической отрасли автоматизировать множество рутинных задач: администрирование информационных систем и баз данных, электронное оформление услуг, обработка звонков контакт-центров и другие операции. Пользователи могут моментально приступать к роботизации, будучи обеспечены нужными серверными мощностями.

«Ключевая задача роботизации рутинных процессов – высвобождение или переориентирование на другой функционал работников компании при одновременном ускорении выполнения задач, – пояснил Евгений Сушков, руководитель пилотного проекта, реализованного «РЖД-Технологии». – На данный момент для трех пилотных площадок – Инновационная мобильность, РЖД-ТехСервис и РЖД-Медицина – мы запустили в эксплуатацию восемь заказных программных роботов».

Клиенты также могут тиражировать роботов для решения задач собственного предприятия через маркетплейс роботизации.

https://glavportal.c…ka-robotov

По сообщению медиацентра «Сколково», «РЖД-технологии» совместно с компанией «Робин» создали платформу программных роботов для транспортно-логистических предприятий.

Эффект: выполнение рутинных операций сократилось на 33,5 %. Общий бюджет проекта 100 млн рублей, из них размер гранта «Сколково» по нацпроекту «Цифровая экономика РФ» 75 млн руб.

Платформа дает возможность транспортно-логистической отрасли автоматизировать множество рутинных задач: администрирование информационных систем и баз данных, электронное оформление услуг, обработка звонков контакт-центров и другие операции. Пользователи могут моментально приступать к роботизации, будучи обеспечены нужными серверными мощностями.

«Ключевая задача роботизации рутинных процессов – высвобождение или переориентирование на другой функционал работников компании при одновременном ускорении выполнения задач, – пояснил Евгений Сушков, руководитель пилотного проекта, реализованного «РЖД-Технологии». – На данный момент для трех пилотных площадок – Инновационная мобильность, РЖД-ТехСервис и РЖД-Медицина – мы запустили в эксплуатацию восемь заказных программных роботов».

Клиенты также могут тиражировать роботов для решения задач собственного предприятия через маркетплейс роботизации.

https://glavportal.c…ka-robotov

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

13 Апреля 2023

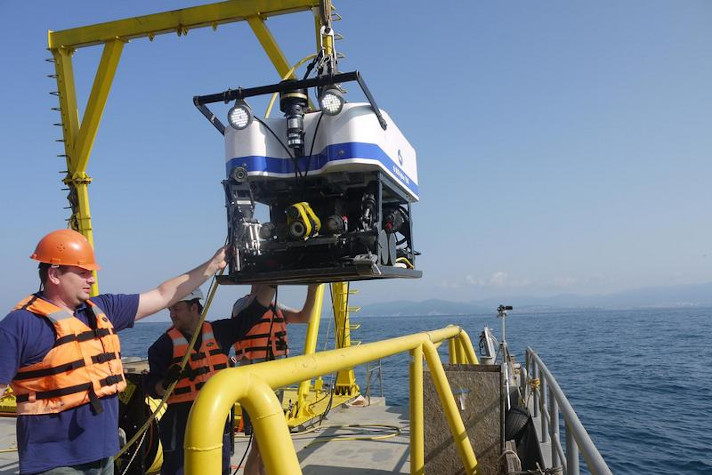

Специалисты-робототехники ФГБУ "Морспасслужба" приняли участие в работе IV научно-практического семинара "Организация и проведение подводно-технических работ на морских объектах добычи и транспорта ПАО "Газпром". Мероприятие прошло в Москве на площадке "Газпром ВНИИГАЗ", рассказали 13 апреля в Росморречфлоте.

Информацию о потенциале учреждения по проведению подводно-технических работ с применением телеуправляемых необитаемых подводных аппаратов (ТНПА) представил заместитель начальника управления робототехники, инструментального и экологического мониторинга "Морспасслужбы" Михаил Растегаев. Среди прочего, в докладе был представлен флот учреждения, обеспеченный современными технологиями работы на море и под водой. В его состав входят современные многофункциональные спасательные суда, в том числе, 15 судов с динамическим позиционированием.

В настоящее время "Морспасслужба" обладает самым большим парком ТНПА в России. В его состав входят аппараты различных классов, позволяющие решать мониторинговые или производственные задачи на глубинах до 3000 метров. Для работы с ТНПА модернизированы более полусотни судов учреждения.

За время деятельности ФГБУ "Морспасслужба" накопило значительный опыт выполнения подводно-технических работ на шельфе РФ, в том числе строительство подводных линий связи и трубопроводов, комплексного обследования уже уложенных и введенных в эксплуатацию линейных объектов, мониторинга экологического состояния устьев скважин на больших глубинах, комплексных подводно-технических работ.

https://sudostroenie…39091.html

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Карма: +52.63

Регистрация: 24.07.2008

Сообщений: 4,167

Читатели: 0

Регистрация: 24.07.2008

Сообщений: 4,167

Читатели: 0

Цитата: Slav Rus от 13.04.2023 12:28:51«Ключевая задача роботизации рутинных процессов – высвобождение или переориентирование на другой функционал работников компании при одновременном ускорении выполнения задач...мы запустили в эксплуатацию восемь заказных программных роботов».

Это вообще не относится к робототехнике.

"Программный робот" - корявый термин, означает, что вместо пользователя на ПК кнопки "нажимает" некая специальная программа.

Механизмов в них нет. Отсутствуют.

Самара

62 года

Карма: +1,033.01

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

Регистрация: 25.01.2016

Сообщений: 9,262

Читатели: 17

Модератор раздела

19.04.2023

В 2022 году продажи логистических роботов в мире увеличились на 66%, на сумму $3,9 млрд. В период с 2019 по 2021 год в общей сложности было продано порядка 620 тыс. ед. роботов, что соответствует среднегодовым темпам роста на 18%.

На специализированной сессии «Робототехнические решения в автоматизации работы склада» в рамках 3-й Конференции по управлению интралогистикой на предприятии было представлено новое поколение мультисенсорных автономных транспортных средств, используемых для решения задач внутренней логистики внутри помещений. Такой робот может автономно транспортировать предметы и перемещаться в окружающей среде. Он также оснащен радаром непрерывного действия для обхода препятствий.

По информации компании «Степень свободы», такой робот имеет встроенную автономную навигационную систему и программное обеспечение для диспетчеризации, которые дают возможность нескольким операторам обслуживать одного робота одновременно, поддерживать работоспособность производства и обеспечивать гибкость его управления.

Диспетчеризация автономных роботов в максимальной степени оптимизирует логистический процесс и делает бизнес более эффективным. Модель также обладает мощными приводами, что обеспечивает высокую скорость перемещения – до 1,5 м в секунду, а наличие системы технического зрения позволяет обнаруживать объекты в пределах дальности видения.

https://www.rzd-part…u-vyrosli/

Мы смеялись в глаза врагу… Хоть нас было всего двадцать восемь

Делай, что должно, и будь что будет.

Делай, что должно, и будь что будет.

Сейчас на ветке:

1,

Модераторов: 0,

Пользователей: 0,

Гостей: 0,

Ботов: 1